Netpeak Spider 3.0: огляд потужного інструменту для аналізу сайту

За створенням, наповненням і оптимізацією сайту, як правило, все ще стоїть людина. А людині, як відомо, властиво помилятися. Тому важливою частиною роботи SEO-спеціаліста є пошук і усунення помилок, які заважають просуванню сайту.

Сьогодні ми розглянемо можливості краулера Netpeak Spider для пошуку ключових помилок внутрішньої оптимізації, підкажемо, як ефективно користуватися налаштуваннями та правильно інтерпретувати отримані дані для покращення оптимізації вашого сайту.

Зміст:

Що вміє Netpeak Spider

Що вміє Netpeak Spider Інтерфейс і результати сканування

Інтерфейс і результати сканування

Налаштування сканування

Налаштування сканування

Важливо знати

Важливо знати Додаткові інструменти

Додаткові інструменти

Резюме

Резюме

Що вміє Netpeak Spider

Netpeak Spider — це десктопна програма для сканування сайтів і аналізу основних параметрів внутрішньої оптимізації на предмет помилок. Інструмент чудово підходить для проведення комплексного SEO-аудиту, контролю впровадження змін сайту з точки зору SEO, а також для аналізу сайтів-конкурентів. З його допомогою ви легко знайдете биті посилання, некоректно заповнені метадані, дублі сторінок і безліч інших цікавинок, що впливають на видимість вашого сайту у видачі пошукових систем.

Для детальнішого знайомства встановлюємо програму на свій ПК. Для цього переходимо на офіційний сайт і або купуємо, або активуємо безкоштовну версію на 14 днів.

Бонус для наших читачів: за промокодом ccd4074c ви отримаєте знижку 10% терміном на один рік!

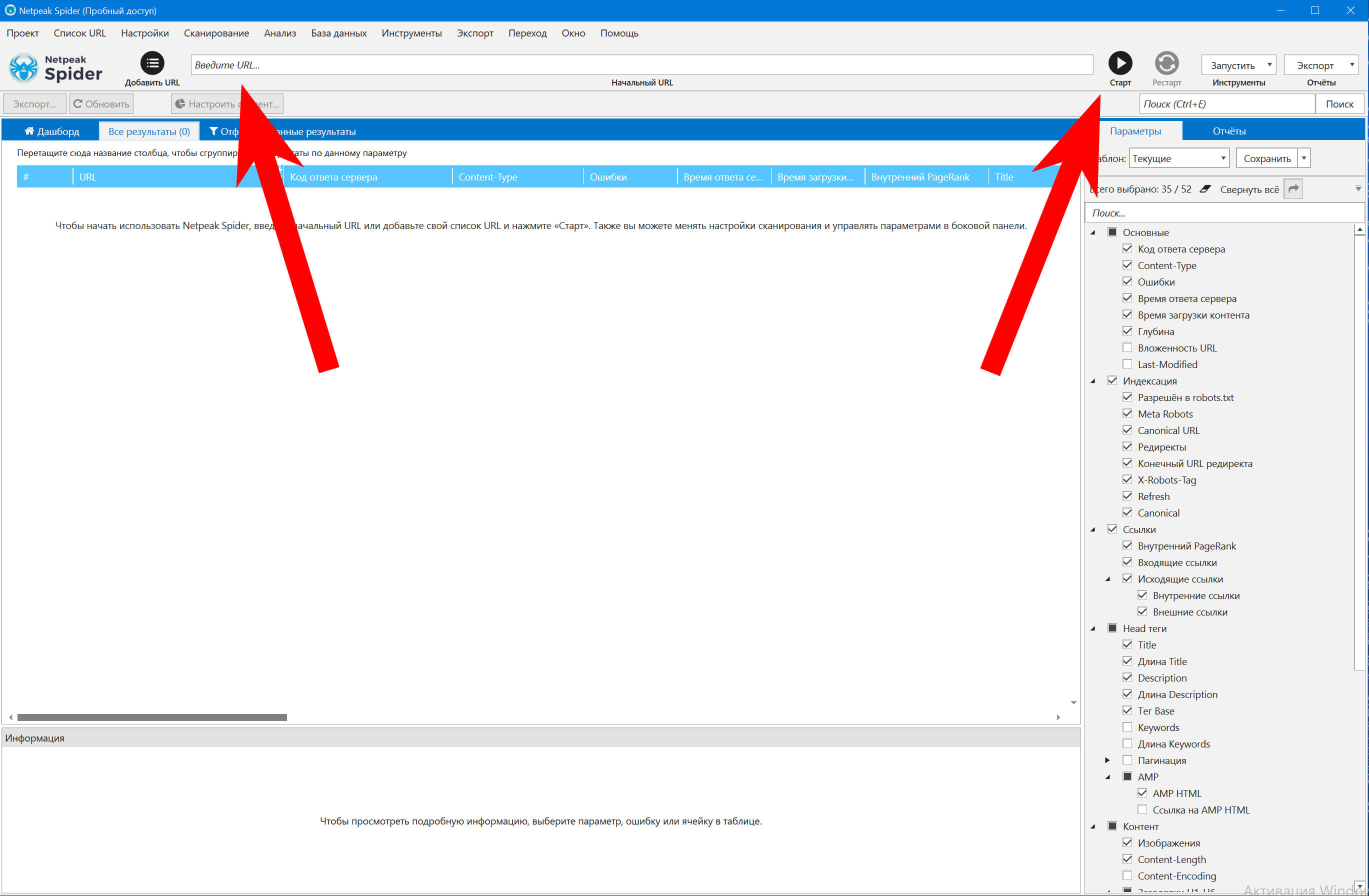

Після того, як програма встановлена на ваш комп’ютер, можемо приступити до першого сканування сайту. Вкажіть URL-адресу і натисніть кнопку «Старт». При першому знайомстві рекомендуємо залишити налаштування «за замовчуванням» і обрати невеликий сайт для скорочення часу сканування:

Дашборд

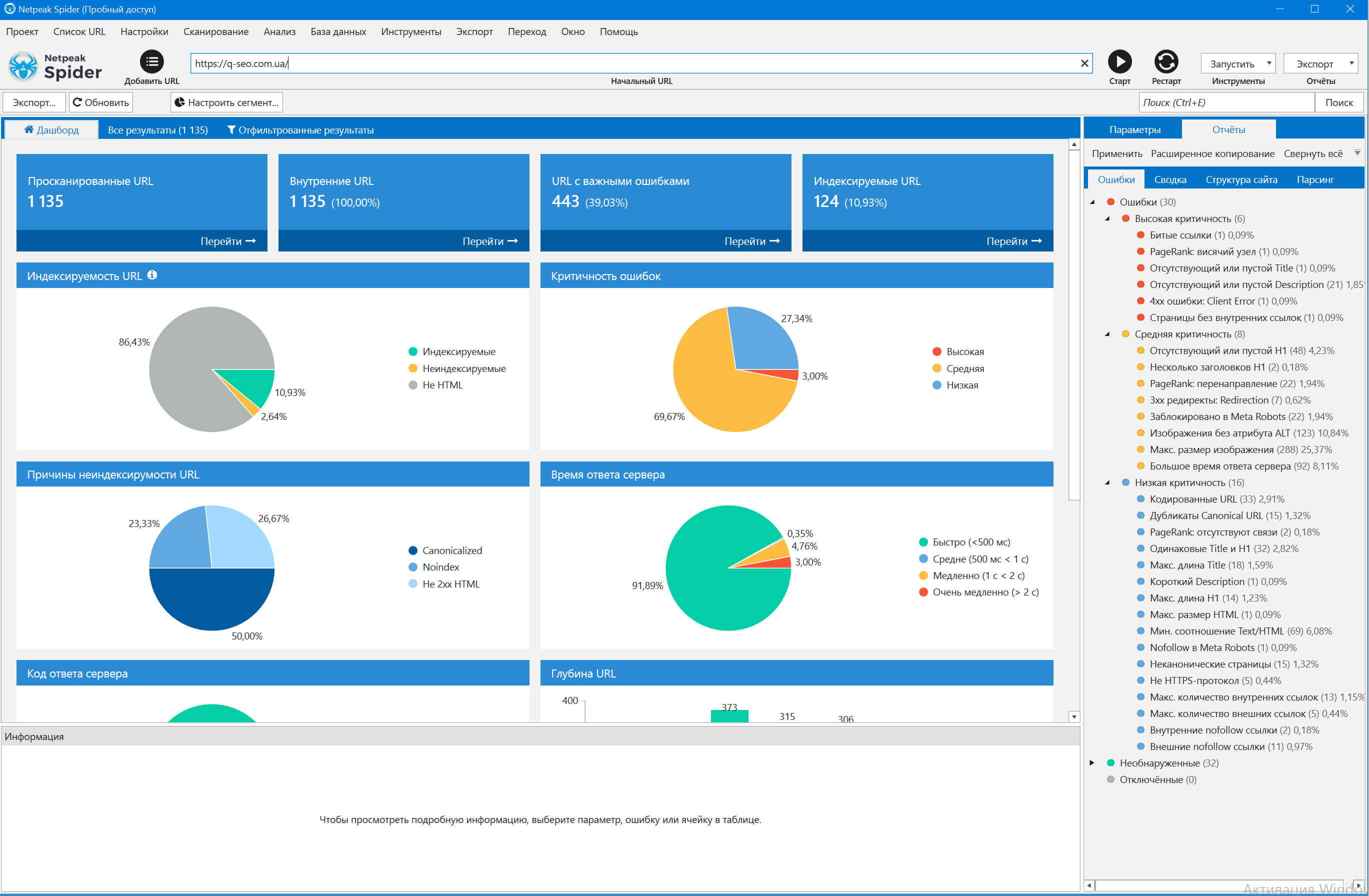

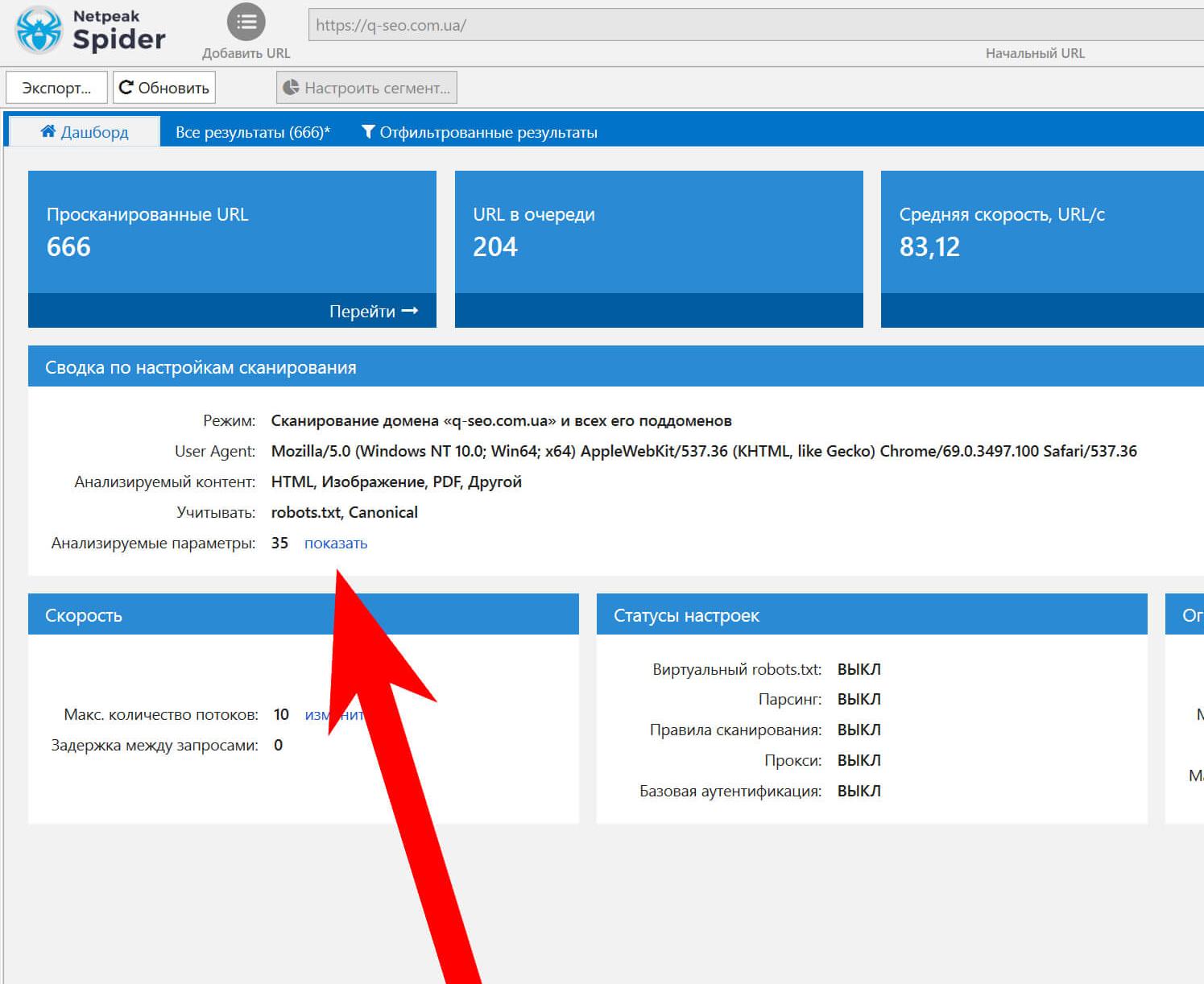

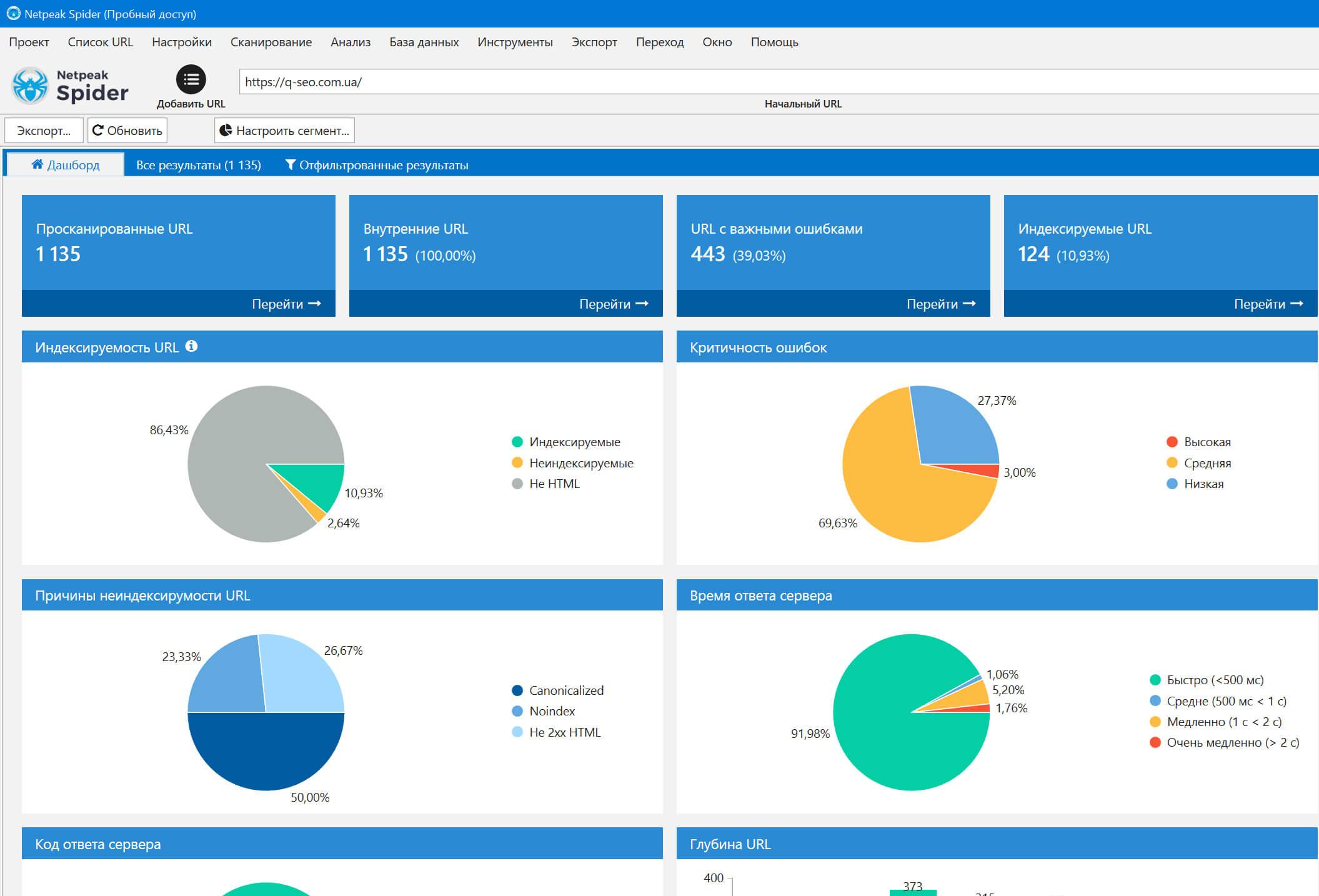

Отже, додаток зустрічає нас досить привабливим інтерфейсом: у лівій частині сторінки відкривається дашборд, що допомагає звернути увагу на ключові дані, а в правій частині інтерфейсу — звіти з виявленими помилками. На сканування сайту Q-SEO пішло менше хвилини:

Які дані ми бачимо на дашборді?

- Проскановані URL: усі адреси сторінок і документів, які роботу вдалося побачити на сайті. Перейшовши за посиланням, ви побачите перелік просканованих URL і доступні дані їхнього аналізу. Адреси з критичними помилками виділені червоним кольором, середньої критичності — жовтим, з незначною важливістю — синім. Для отримання детальних даних по певній адресі просто клікніть по ній — дані відобразяться у вікні «інформація».

- Внутрішні URL: у налаштуваннях за замовчуванням зовнішні URL не скануються, тому кількість внутрішніх URL має збігатися з кількістю просканованих URL.

- URL з важливими помилками: відфільтровані результати сканування з тими адресами сторінок, де краулер виявив помилки.

- Індексовані URL: адреси сторінок, доступні для індексування тією пошуковою системою, робота якої ви використовуєте для сканування. Тобто, якщо ви зараз використовуєте бота Google для обходу сайту і результати звіту «Індексовані URL» вас повністю влаштовують, це не означає, що ці ж адреси сторінок будуть доступні, наприклад, для Baidu чи Bing. Змінити пошукового бота можна в налаштуваннях User Agent.

Безпосередньо під час сканування сайту ви можете відобразити параметри, що аналізуються, натиснувши на відповідне посилання:

Після завершення сканування за допомогою діаграм будуть візуалізовані дані щодо співвідношення індексованих і неіндексованих URL, отриманих кодів відповіді сервера, часу відповіді сервера, типу контенту тощо. Усі елементи діаграм клікабельні і дозволять вам швидко перейти до потрібних даних.

Сегменти

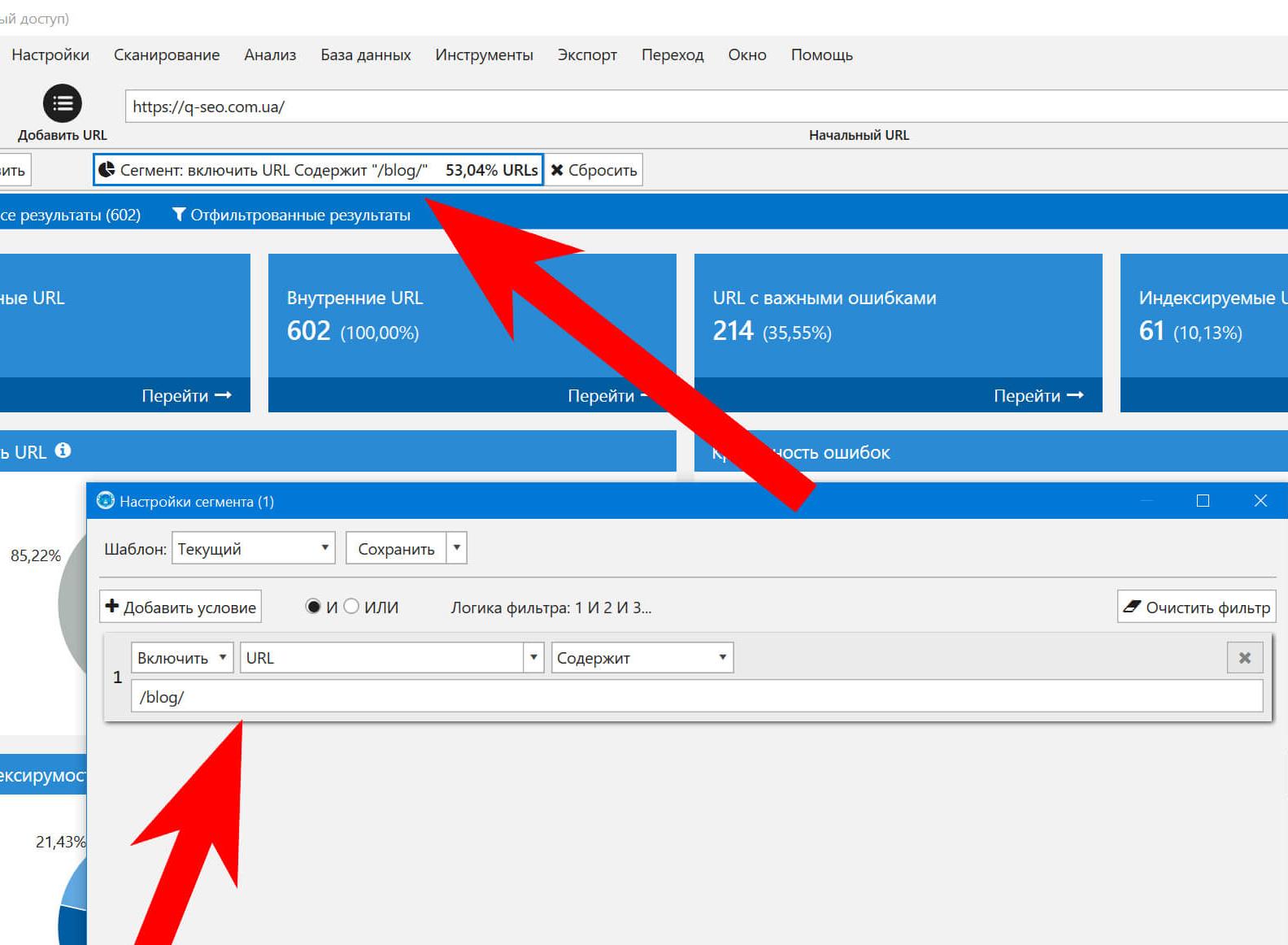

Принцип роботи з сегментами схожий на налаштування сегментів у Google Analytics, добре знайомих багатьом SEO-спеціалістам: за заданими параметрами виділяється певна частина даних для подальшого вивчення.

Дуже зручно використовувати сегменти для аналізу помилок на всіх сторінках певної частини сайту. Наприклад, для нашого сайту ми виділили в окремий сегмент усі сторінки блогу:

.

Ви можете створювати сегменти залежно від ваших завдань: наприклад, для інтернет-магазину будуть корисними сегменти за конкретними категоріями або сегмент, де будуть представлені лише сторінки товарів.

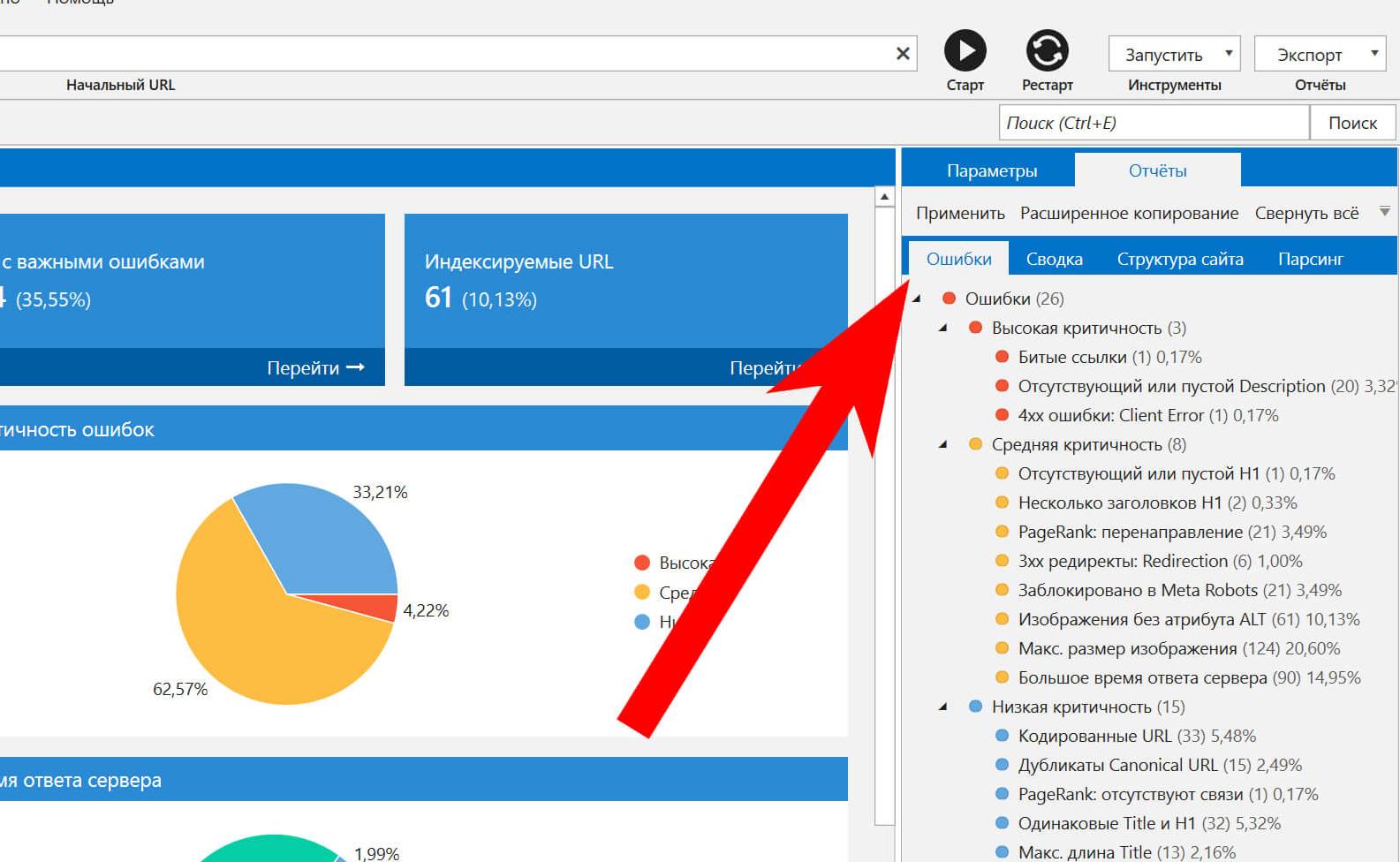

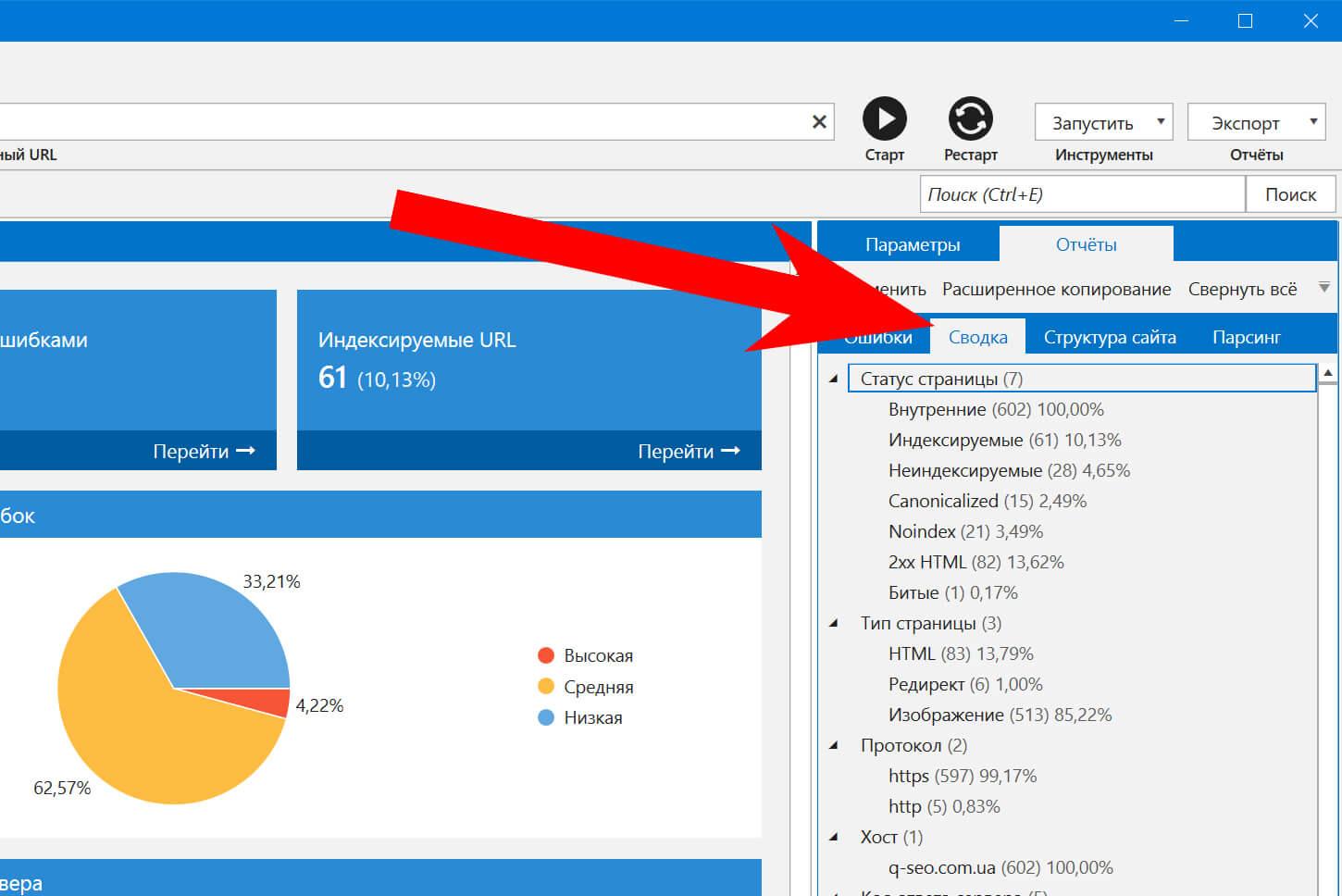

Звіти

Звіти згруповані в правій частині інтерфейсу, за замовчуванням відкрита вкладка «Помилки», як найбільш важлива для аналізу. Дані відсортовані за ступенем важливості — найбільш критичні помилки розташовані вище менш критичних, що зручно для сприйняття. Клік по будь-якому з пунктів звіту дозволить побачити відфільтровані дані з URL, на яких і була виявлена відповідна помилка.

Вкладка «Зведення» дозволить вам швидко звернутися до даних, що стосуються певного типу або статусу сторінки. Частково ці ж дані відображаються на сторінці «Дашборд».

Вкладка «Структура сайту» наочно показує, яка кількість документів належить до тієї чи іншої групи сторінок (якщо структура URL сайту це дозволяє). Рекомендуємо вивчати дані цього звіту при аналізі конкурентів для інтернет-магазинів — можна легко дізнатися, яка кількість товарів представлена в тій чи іншій категорії.

Усі звіти легко експортуються в .xls або .csv файли, а також копіюються в буфер обміну за допомогою кнопки «Розширене копіювання».

Ви також можете зберегти повністю весь проєкт, якщо плануєте продовжити аналіз даних без повторного сканування.

Налаштування сканування

Netpeak Spider — інструмент насамперед для професіоналів, тому розробниками передбачена можливість налаштування практично будь-яких параметрів сканування:

Основні налаштування

В основних налаштуваннях ви зможете встановити мову програми, вказати кількість потоків сканування, час очікування відповіді сервера на запит програми. Крім цього, доступна опція «сканувати лише в межах розділу» для уникнення обходу роботом непотрібних вам сторінок, а також вибір типу контенту, який оброблятиме програма.

Просунуті налаштування

Просунуті налаштування так і називаються, оскільки вимагають від користувача розуміння принципу директив для пошукових роботів. Сенс налаштування зводиться до врахування або ігнорування певних правил для пошукових ботів, які використовуються на вашому сайті. Наприклад, сканування без врахування директив robots.txt, canonical і Meta Robots призведе до отримання набагато більшого списку URL, ніж сканування з їх урахуванням (у більшості випадків).

Умови зупинки сканування, мабуть, авансом потрапили до «просунутих», хоча логічніше було б перенести їх у вкладку «основні», де призначається кількість потоків і максимальний час очікування відповіді сервера.

Також у просунутих налаштуваннях ви можете дозволити сканування сторінок, що віддають відповідь сервера 4xx, і файли cookies.

Візуальний robots.txt

У цьому розділі ви можете налаштувати сканування сайту, враховуючи ваш власний віртуальний файл robots.txt, а не реальний файл, розташований на сервері. Дуже зручна функція в разі, коли у вас немає доступу до файлів сайту, або коли ви хочете перевірити зміни в robots.txt до фактичного оновлення самого файлу.

Парсинг

Парсинг — це загалом дуже цікава функція, яку ми рекомендуємо використовувати на ваших проєктах. З її допомогою, наприклад, на великому сайті можна легко скласти перелік сторінок, на яких відсутній код Google Analytics або атрибути hreflang.

Крім цього, парсити можна і сайти конкурентів, наприклад, з метою порівняння цін на товари.

Звісно, для ефективного використання цього інструменту потрібно розуміти, що таке CSS-селектор і регулярні вирази.

User Agent

За допомогою вибору бота ми можемо «побачити» сайт очима різних пошукових систем і переконатися в його коректному скануванні. Переконатися, що ваш сайт відповідає вимогам алгоритму «mobile first index», можна, увімкнувши сканування за допомогою гуглбота для смартфонів.

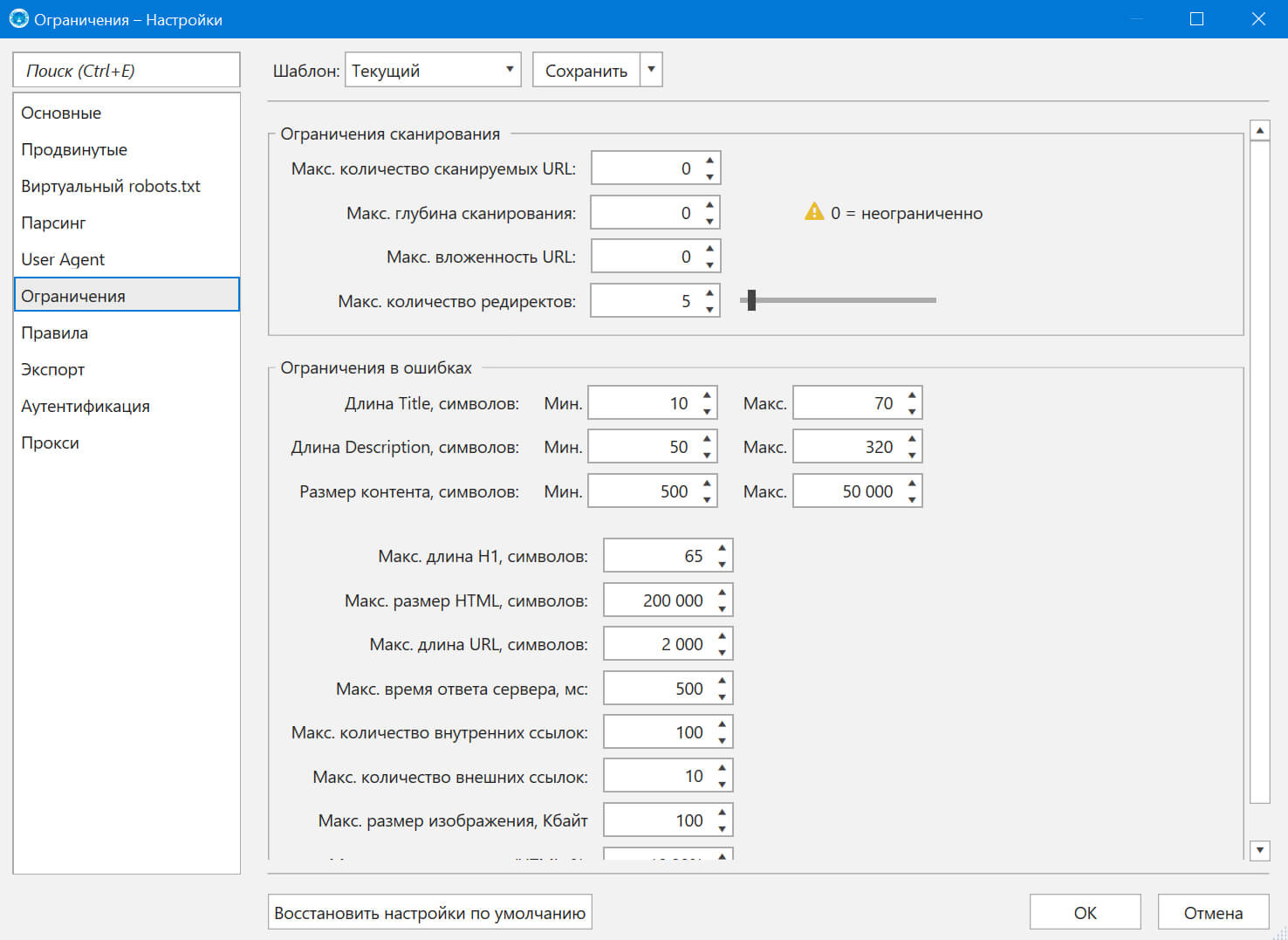

Обмеження

Любите довгі title і не хочете, щоб краулер розпізнавав їх як помилку?

Просто змініть цей параметр у розділі обмежень. Решта налаштувань також інтуїтивно зрозумілі і можуть бути встановлені відповідно до ваших вимог.

Правила

Якщо сегмент дозволяє вам виділити частину з усіх даних сканування, то за допомогою правил ви можете одразу спрямувати сканування лише на потрібні сторінки, тим самим суттєво зменшивши час для отримання результатів.

Netpeak Spider дозволяє створювати правила за допомогою логічних операторів «і» та «або». Перший використовується для створення складних правил, у яких для сканування має збігтися кілька умов. Оператор «або» застосовується, якщо для сканування має збігтися хоча б одна з потрібних вам умов.

Для прикладу створимо правило, де виключимо зі сканування всі сторінки блогу та портфоліо:

Експорт

У розділі експорту ви можете змінити стандартні налаштування для експорту звітів:

Аутентифікація

Налаштування аутентифікації необхідні, коли досліджуваний сайт за замовчуванням недоступний для обраного бота. Наприклад, коли сайт перебуває на етапі розробки і прямий доступ до нього закритий.

Проксі

Нерідко трапляється ситуація, коли зарубіжні хостинги блокують українські та російські IP-адреси під час парсингу сайту. Якщо ви зіткнулися з такою проблемою, використання проксі-серверів допоможе її вирішити.

Важливо знати

При роботі з Netpeak Spider є кілька «фішок», які суттєво полегшать вам життя:

1. Ви завжди можете зупинити сканування і продовжити його в зручний момент.

Для цього потрібно просто зберегти проєкт, а коли знадобиться продовжити сканування, відкрити його і натиснути кнопку «Старт».

2. Пересканування окремих URL або їхніх списків.

Коли ви виправили помилку на окремій сторінці або групі сторінок, не потрібно знову витрачати час на сканування всього сайту. Виберіть цю помилку в бічній панелі і запустіть пересканування лише тих сторінок, де вона була знайдена. За аналогією можна запустити «перепробивку» будь-якого потрібного URL:

3. Зміна параметрів під час сканування

Досить часто в процесі сканування ви зрозумієте, що отримуєте непотрібні вам параметри як дані. Тепер ви можете просто зупинити сканування, змінити будь-які налаштування (наприклад, вимкнути зайві параметри), а потім продовжити сканування, але вже з урахуванням нових налаштувань.

Додаткові інструменти

Аналіз вихідного коду та HTTP-заголовків

За допомогою цього інструменту ви можете зберегти вихідний код будь-якої сторінки, а також інформацію з HTTP-заголовка відповіді сервера. Також інструмент витягує текстовий контент сторінки:

Розрахунок внутрішнього PageRank

Цей інструмент дозволить вам наочно оцінити, скільки «ваги» отримує та чи інша сторінка завдяки внутрішнім посиланням. Ви наочно можете побачити, які сторінки потребують додаткових посилань, і провести оптимізацію своєї внутрішньої перелінковки.

Валідатор XML Sitemap

Валідатор XML допоможе швидко знайти помилки в наявній карті сайту. Просто вкажіть адресу, за якою розташована XML-карта сайту, і сервіс перевірить її вміст на дублі та коректність заповнення.

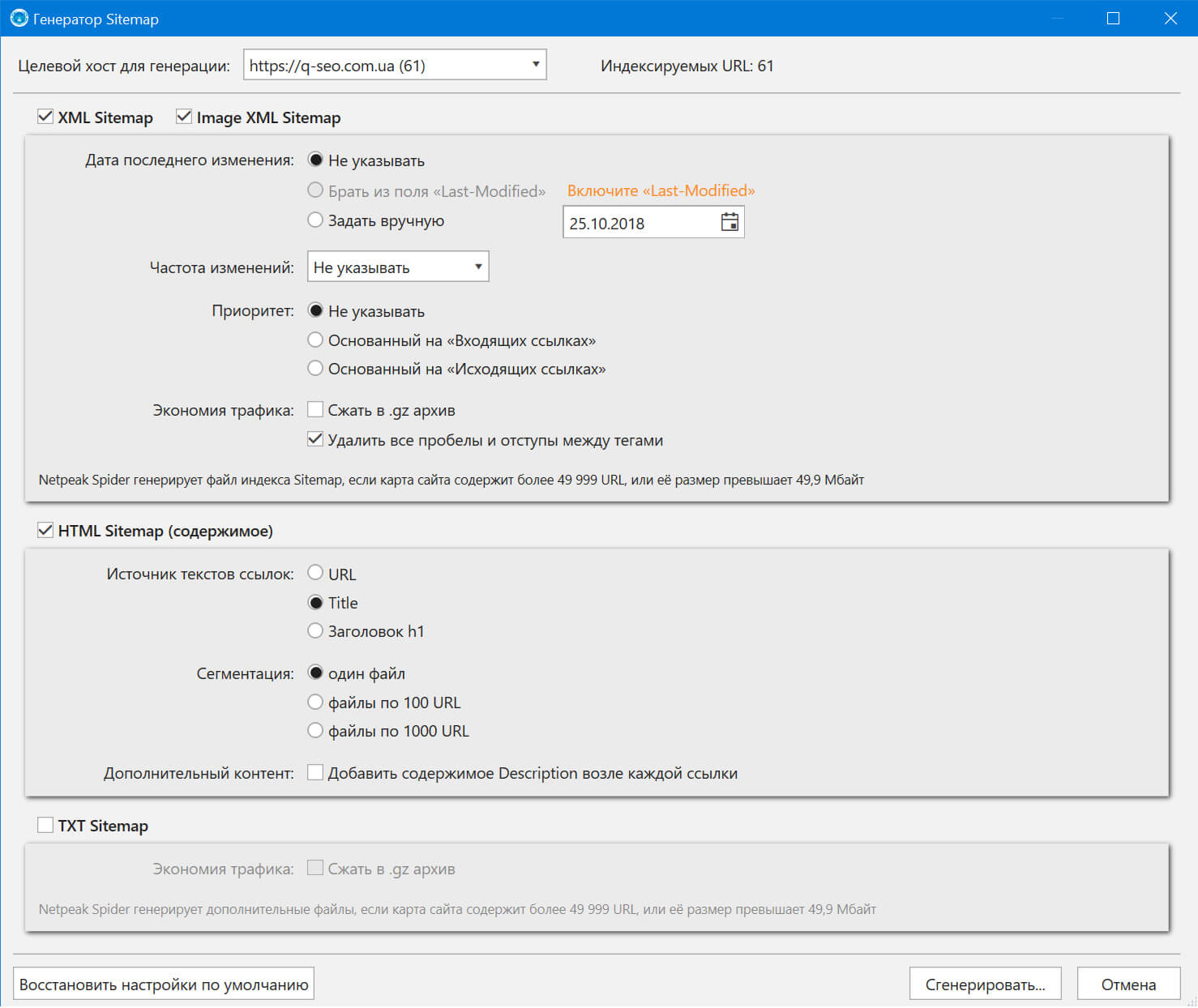

Генератор XML Sitemap

Дозволяє в кілька кліків створити кастомну XML-карту сайту, враховуючи саме ті параметри, які ви вважаєте необхідними.

Резюме:

Netpeak Spider — досить потужний краулер, що дозволяє швидко проаналізувати сайт на ключові помилки, однак розрахований насамперед на досвідчених оптимізаторів, які вміють правильно аналізувати отриману інформацію та витягувати зі звітів дійсно корисні дані.

Деякі питання викликає юзабіліті звітів: наприклад, не дуже зручно подивитися, на яких саме сторінках розміщені посилання, що йдуть через 301 редирект, але розробники постійно вдосконалюють продукт, що вселяє надію на оптимізацію шляху користувача до потрібної інформації.

Завдяки чудовим можливостям зміни налаштувань під свої потреби Netpeak Spider напевно стане корисним інструментом в арсеналі будь-якого SEO-спеціаліста.