Інструмент Google Webmaster: «Параметри URL-адрес» – покращуємо канонізацію сайту в індексі Google

Ні для кого не секрет, що дубльований контент, розміщений на інтернет-ресурсі, негативно впливає на ранжування сайту в цілому, пошукові системи знижують такий контент у SERP, а іноді й штрафують сайти недобросовісних вебмайстрів, аж до застосування фільтрів. Тому будьте уважні, коли «переїжджаєте» з однієї CMS-системи на іншу, а також при реструктуризації свого сайту, постійно стежте за індексом сторінок у Google і Яндекс, адже якщо внутрішні роботи з додавання нового контенту не проводилися, а сторінок у пошуковому індексі значно побільшало, це може свідчити про збій CMS і генерацію дублікатів на сайті. Таке трапляється досить рідко, але все ж буває.

На сьогоднішній день є багато способів не допустити потрапляння дубльованого контенту в індекс пошукових систем (мета-тег robots, canonical, 301 редирект, robots.txt тощо), усі вони працюють непогано, однак компанія Google пішла назустріч вебмайстрам і впровадила в панель Google Webmaster Tools чудову утиліту «Параметри URL», яка дозволяє за заданими параметрами URL-адреси повідомляти пошуковому боту Google, які сторінки слід ігнорувати при індексації сайту.

В принципі, це дуже хороший спосіб заборонити сканування дублікатів сторінок сайту, тим самим покращивши довіру до сайту з боку пошукової системи. Цей метод також зручний, якщо вам бракує знань у сфері програмування і, як наслідок, складно реалізувати використання рекомендованих тегів (мета-тег robots, тег canonical). Звісно, ще як варіант можна закривати дубльований контент у robots.txt, але сам Google не гарантує, що сторінки, заблоковані у файлі robots.txt, не з’являться в результатах пошуку. Докладніше про блокування URL-адрес за допомогою robots.txt можна ознайомитися в довідці Google.

Хоча, яким би хорошим не був інструмент, який ми розберемо в цій статті, у нього є й недолік, адже він працює лише з пошуковою системою Google, тому для досягнення максимального результату рекомендується використовувати низку методів блокування дубльованих URL-адрес для інших ботів.

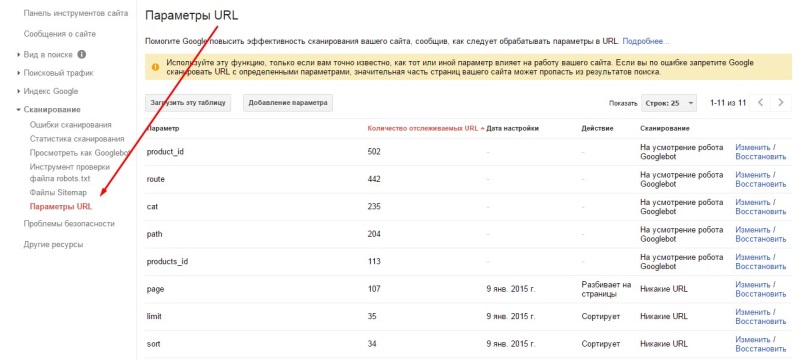

Отже, повернемося до ознайомлення з утилітою «Параметри URL» у панелі Google Webmaster Tools. Як же працює цей інструмент? Суть його роботи полягає в наступному: щойно Googlebot виявляє однакові параметри URL, відбувається групування всіх URL-адрес із повторним вмістом в один блок із загальним параметром. На практиці це виглядає так:

Тут потрібно бути дуже обережним і використовувати цей інструмент лише в тих випадках, якщо відомо, як формуються URL-адреси вашого сайту, адже можна заборонити індексацію більшої частини сторінок вашого ресурсу, які згодом можуть зникнути з результатів пошуку. Але, тим не менш, інструмент добре допомагає виключити з індексації такі сторінки, де використовуються однакові параметри, як-от: page, limit, sort, order, filter тощо, які сортують або розбивають вміст сторінки. Такі параметри ще називають «активними параметрами». Активні параметри впливають на вміст сторінки, тобто можуть:

- Сортувати – сортує вміст на основі заданого параметра. Наприклад, відображає список товарів, відсортованих за назвою, брендом або ціною (приклад, sort=price);

- Обмежувати – відображає частину вмісту відповідно до значення параметра. Наприклад, лише сукні розміру M;

- Вказувати – задає вміст сторінки, наприклад тему, аудиторію, номер товару тощо;

- Перекладати – відображає вміст мовою, яка задана параметром (наприклад, lang=fr);

- Розбивати – відображає конкретну сторінку довгої статті (наприклад, page=2).

- Інше – змінює вміст будь-яким іншим способом.

Це основні дії, які можна використовувати для масового блокування дубльованого контенту на сайті. Наприклад, нам потрібно обмежити сканування сторінок пагінації, для цього слід виконати низку нескладних дій: вибрати потрібний параметр «page» (якщо пошуковий бот уже просканував сторінки сайту) або задати його вручну.

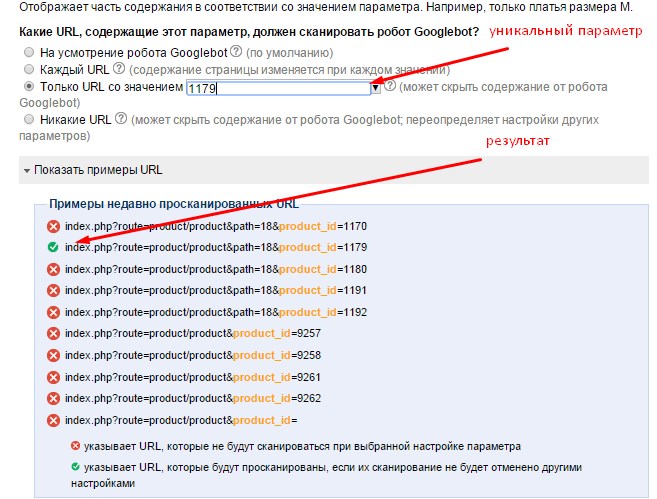

У спливаючому вікні можна побачити, до яких URL-адрес застосовуватимуться певні «дії» – вкладка «Показати приклади URL».

Якщо приклади URL-адрес нам підходять і ми хочемо, щоб бот їх ігнорував при наступному скануванні сайту, виконуємо налаштування цього параметра. Для початку вибираємо параметр вмісту сторінки: у нашому випадку це «Так, параметр змінює, реорганізовує або обмежує вміст сторінки» – «активний параметр». Система також пропонує «пасивний параметр», який використовується для підрахунку переглядів і переходів, не впливаючи на фактичний вміст сторінки, застосовується дуже рідко і залежить від CMS-системи.

Інструмент надає кілька варіантів обробки параметрів:

- На розсуд робота Googlebot – за замовчуванням (універсальний варіант).

- Кожен URL – Робот Googlebot використовуватиме значення вибраного параметра для визначення унікальності URL, тобто посилання типу index.php?route=product/product&path=18&product_id=1170 і index.php?route=product/product&path=18&product_id=1179 вважатимуться різними.

- Тільки URL зі значенням – дозволяє задати конкретний параметр URL, який має певне значення. URL-адреси з іншими значеннями ігноруватимуться.

- Жодні URL – забороняє Googlebot сканувати всі URL-адреси з цим параметром (використовується для сторінок: сортування, фільтрації тощо).

Як бачите, інструмент «Параметри URL» не такий уже й складний у використанні та має досить гнучкі налаштування, що робить його досить привабливим у боротьбі з дублікатами сторінок сайту. На цьому короткий огляд інструменту «Параметри URL» ми завершимо. Не забувайте підписуватися на наші новини, щоб бути в курсі всіляких «SEO-фішок». Усього доброго. І успіхів у нелегкій боротьбі з дубльованим контентом. Залишайтеся з нами!